Erfundene Gesetze, echte Reichweite – wie KI-Fakes auf Tiktok Desinformation verbreiten

Kanäle auf Tiktok denken sich massenhaft falsche staatliche Vorschriften aus. Vielfach sind die Inhalte KI-generiert und verstoßen gegen die Tiktok-Richtlinien. Die Plattform kennt das Problem – reagiert aber nur vereinzelt und bekommt die Masche nicht in den Griff. Eine GADMO-Recherche des Faktencheck-Teams der Deutschen Presse-Agentur (dpa).

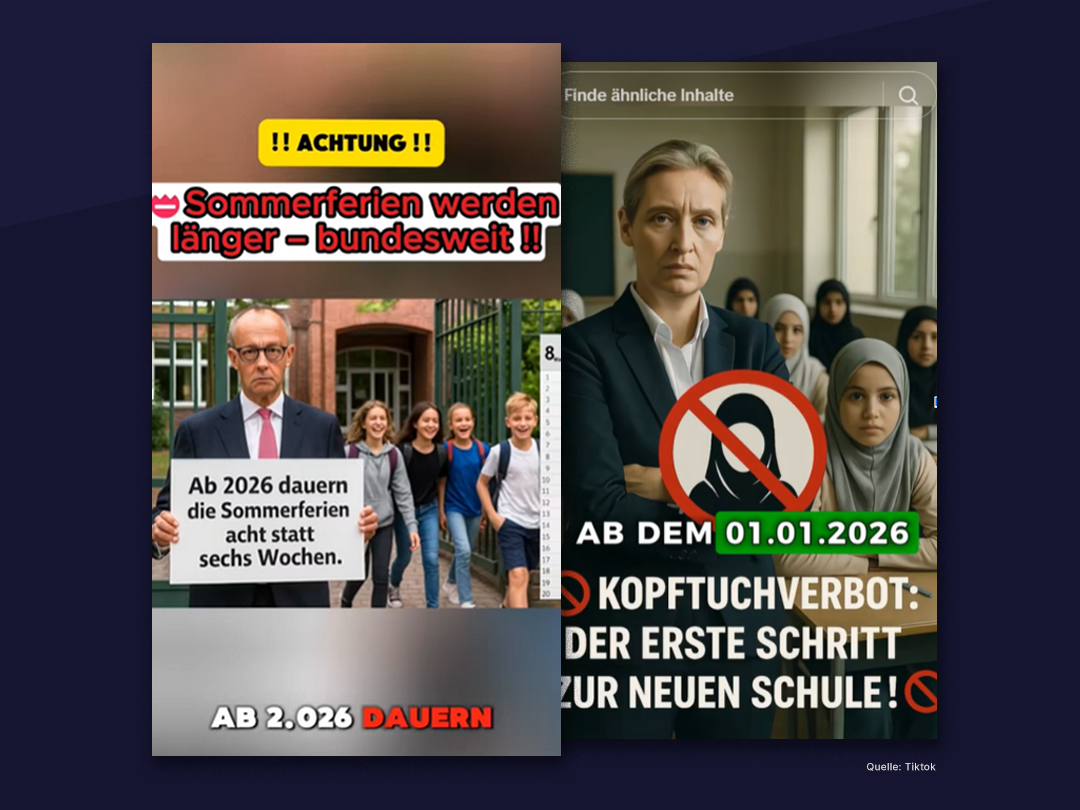

Es ist Anfang August, mitten in den Sommerferien, als Nutzer auf Tiktok eine Sensationsnachricht lesen. „Acht Wochen Sommerferien ab 2026? Ein neuer Vorschlag sorgt gerade für Aufregung unter Eltern, Lehrern und Schülern“, sagt ein Mann in die Kamera. Im Hintergrund ist eine Darstellung von Kanzler Friedrich Merz mit strengem Blick am Rande eines Schulhofs zu sehen.

Viele User nehmen die Botschaft ernst: „Wir haben glaube ganz andere Probleme, als über 8 Wochen Sommerferien zu diskutieren 🤦♀️Man kann die ganzen Ferien sowieso nicht mit dem Urlaub abdecken. Gibt es dafür mehr Geld und Urlaub? Unfassbar !!!“, schreibt eine Kommentatorin. Mehr als 4000 Accounts beteiligen sich an der Diskussion, das Video wird mehr als 720.000 Mal angesehen. Jede Menge Freude und Frust – ausgelöst von einer Meldung, die komplett erfunden ist. Vorgetragen von einem KI-Avatar, nicht von einem echten Menschen.

Dennoch verbreitet sich die Geschichte weiter. In den Tagen danach taucht die Falschbehauptung auf weiteren Accounts der Plattform auf. Das Verifikationsteam der Deutschen Presse-Agentur (dpa) veröffentlicht am 12. August einen Faktencheck. Die dpa-Tochter dpa-infocom kooperiert unter anderem mit Meta und Tiktok im Rahmen der Faktencheck-Programme der Plattformen.

Die Verbreitung bremst der Faktencheck nicht. Tage später ist die fingierte Ferien-Verlängerung auch auf anderen Plattformen wie Youtube angekommen.

Falschmeldungen nach diesem Muster sind kein Einzelfall. Der Sommerferien-Fake ist Teil einer Masche, die sich nicht nur, aber vor allem auf Tiktok findet. In den Videos wird immer eine angebliche Neuregelung präsentiert, die in den Alltag der Nutzerinnen und Nutzer eingreift. Mit den erfundenen staatlichen Regeln wollen die Macher Reichweite generieren, lösen aber gleichzeitig erhebliche Verunsicherung aus. Seit dem Frühsommer 2024 beobachtet das Faktencheck-Team der dpa das Phänomen, auch anderen Faktencheckern fällt es auf. Auch der “Faktenfuchs” des Bayerischen Rundfunks veröffentlichte kürzlich eine Recherche dazu.

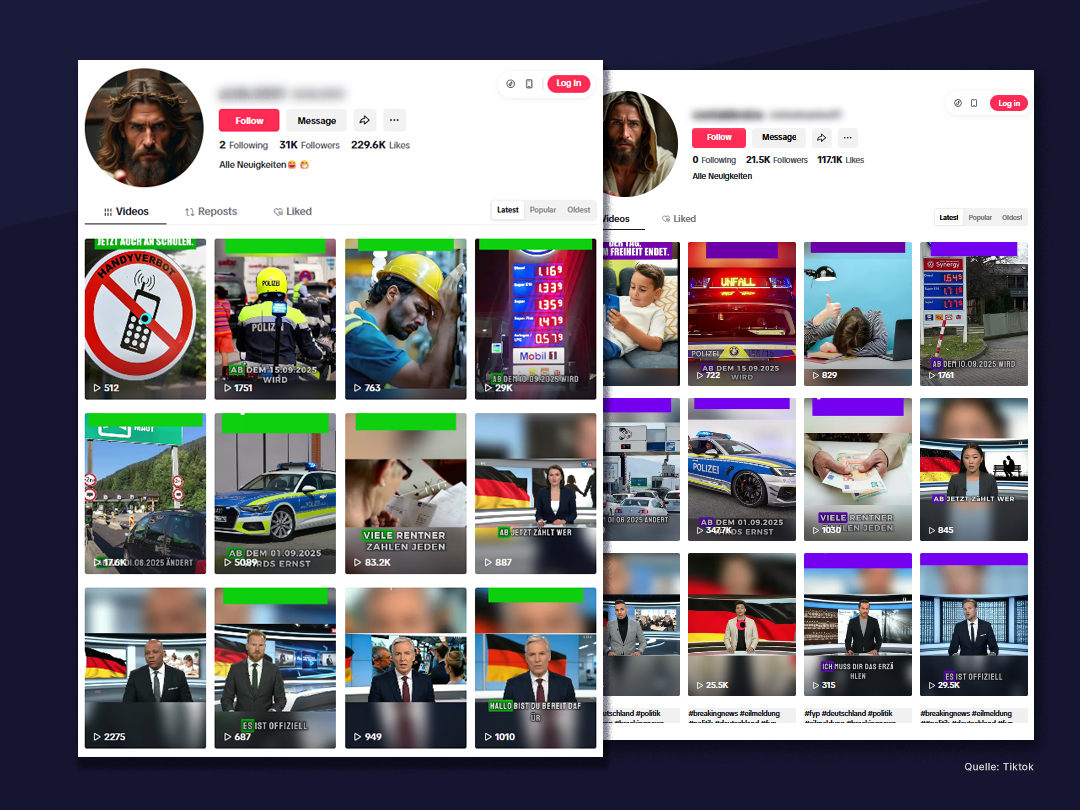

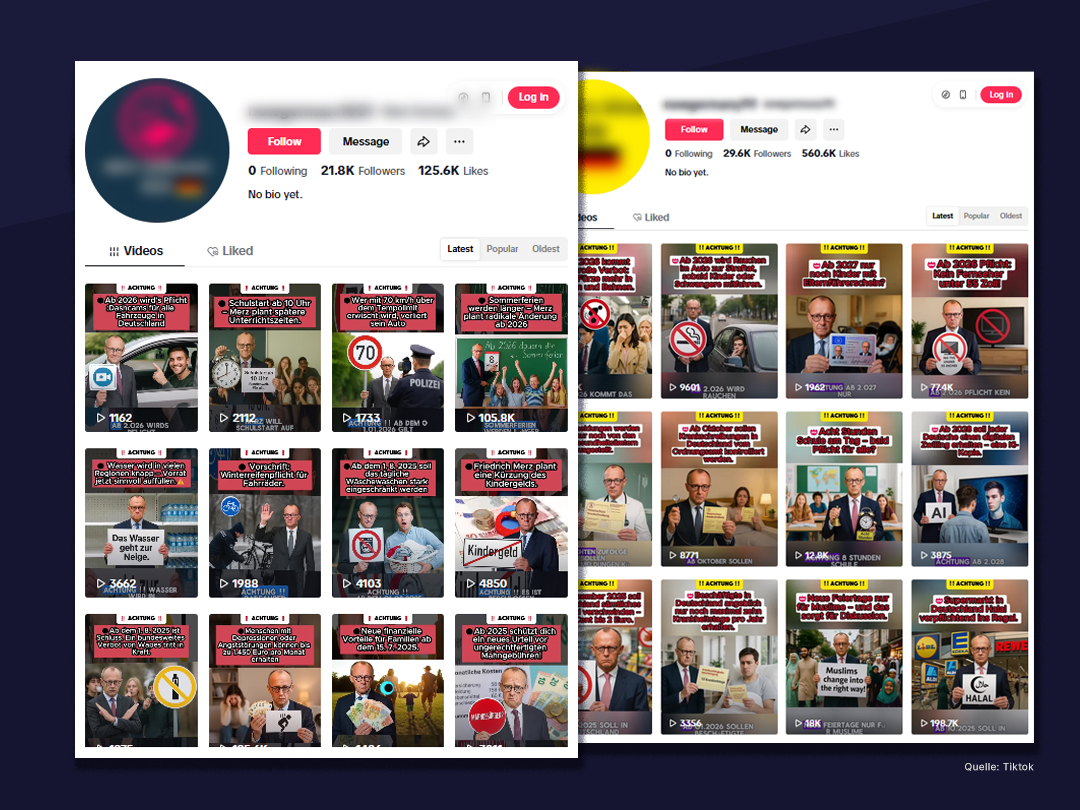

In dieser Analyse hat das dpa-Team für GADMO 32 Tiktok-Accounts untersucht, die fast ausschließlich solche Videos über erfundene neue Vorschriften der Politik verbreiten. Mehrere Videos erreichten Millionen Nutzer. Auf allen gab es Hinweise auf die Verwendung von KI, oft, ohne dass dies gekennzeichnet wurde. Die Motive der Verbreiter bleiben im Dunkeln. Doch die Masse an Falschinformationen ist geeignet, bei vielen Menschen grundsätzliches Misstrauen gegenüber dem Staat zu säen.

Wie funktioniert die Tiktok-Masche mit den erfundenen Behörden-Vorschriften?

Viele Videos in den 32 untersuchten Accounts folgen einem Muster: Zu Beginn sagt eine Stimme „Achtung“, „Eilmeldung“ oder „Schock“, um Aufmerksamkeit zu wecken. Dann nennt sie den vermeintlich nahen Stichtag: Ab dem 1. Tag eines bestimmten Monats sei es so weit, dann trete die angeblich neue Regelung in Kraft: zum Beispiel Einschränkungen für Autofahrer oder ein neues Kopftuchverbot.

Die Videos setzen auf Sensationslust und Emotionalisierung. Die vermeintlichen Reformen werden als „drastisch“ oder „eine wichtige Änderung“ angekündigt. Großbuchstaben und Ausrufezeichen in den Videos sollen offensichtlich Dringlichkeit vermitteln.

KI ermöglicht Video-Erstellung ohne viel Aufwand

Dass die Videos in solchen Massen erstellt werden können, ist eine Folge der technologischen Entwicklung: Auf allen 32 untersuchten Accounts waren Hinweise auf die Nutzung Künstlicher Intelligenz zu finden. Der Sprecher aus dem Off ist in der Regel eine KI-Stimme. Immer wieder lässt sich das an falschen Betonungen, unnatürlichen Pausen und plötzlichen Akzenten erkennen.

Auch die Optik ist geprägt vom Einsatz von KI. Wurden anfangs auf einigen Accounts noch echte Fotos eingeblendet, dienten zuletzt vor allem KI-generierte Bilder zur Illustration der angeblichen Vorschriften. Mal ist dann ein streng blickender Friedrich Merz auf dem Schulhof zu sehen. Mal eine KI-Version von Alice Weidel, die zu einem erfundenen Kopftuchverbot in einer Schulklasse mit Kopftuch tragenden Mädchen gezeigt wird.

Die massenhafte Erstellung von KI–Videos mit falschen, irreführenden oder banalen Inhalten ist mittlerweile unter dem Schlagwort „AI Slop“ bekannt, in etwa KI-Schrott. Mit den verfügbaren KI-Modellen zur Text- und Bildgenerierung produzieren die Macher solcher Videos minderwertigen Content, mit dem sie Plattformen wie Tiktok oder Instagram fluten und regelrecht vermüllen.

„Inzwischen geht das teilautomatisiert, indem man diverse Accounts sich quasi selbst befüllen lässt“, sagt der Politik- und Kommunikationswissenschaftler und Tiktok-Experte Marcus Bösch. Tiktok sei als Infrastruktur dafür extrem gut geeignet. „Durch die algorithmische Empfehlung gibt es kein System mehr wie noch früher mit einem Social Circle auf Instagram und Facebook. Dort musste man solche Accounts erst hochzüchten. Auf Tiktok kann schon das allererste Video gegebenenfalls viral gehen“, so Bösch. Die Betreiber der Accounts sind also nicht mehr abhängig davon, sich erst aufwändig eine Community aufzubauen.

Auf einigen Accounts lässt sich nachvollziehen, mit welchen Programmen die AI-Slop-Videos entstanden sein könnten. So sind die Presenter in vielen Videos Comic-Figuren, die Nutzern von den angeblich drohenden Vorschriften erzählen. Mitunter prägen sie den gesamten Auftritt eines Accounts. Viele davon sind als Avatare des Grafikdesign-Tools „Express“ vom US-Softwareunternehmen Adobe auffindbar, dort tragen sie Namen wie „Amos“, „Cecil“, „Mark“ und „Dr. Applesmith“. Das Tool ermöglicht Nutzern, Figuren auf Grundlage einer Audiodatei zu animieren. Auch ein Logo der kostenlos verfügbaren App „Fotoplay“ findet sich in einem Video. Mit der Software lassen sich einfach und schnell Videos bearbeiten. Die Beispiele zeigen, dass mit der Verbreitung von KI-Tools weder besondere Kenntnisse noch teure Software gebraucht werden, um solche Videos in Massen herzustellen.

Verbindungen zwischen Accounts erkennbar

Die 32 untersuchten Accounts lassen sich auf Grundlage verschiedener Merkmale grob fünf Gruppen zuordnen. Tiktok-Accounts einer Gruppe verwenden etwa ähnliche Benutzernamen, identische Links in der Bio, ähnliche KI-Bilder als Profilbild sowie fast identische Videos mit ähnlichen, nur leicht variierten Layouts. Teilweise teilen die Profile die Clips von anderen Accounts, das deutet auf einen Zusammenhang hin. Ob dahinter tatsächlich der gleiche Account-Betreiber steht, ließ sich nicht bestätigen.

Massentaugliche Inhalte, Reizthema Geld

Die Themen der Videos bieten für viele Menschen Anknüpfungspunkte: Zu Inhalten wie den „acht Wochen Sommerferien“ hat fast jeder eine Meinung. Auch das Reizthema Geld spielt immer wieder eine Rolle: So verbreiten sich über mehrere Kanäle hinweg irreführende Clips über eine 700 Euro hohe Bonuszahlung für Eltern. Was sie dafür angeblich tun müssten? Lediglich das gelbe Kinderuntersuchungsheft bei einer Krankenkasse einreichen. In manchen Videos ist von einem „Anspruch auf 700 Euro“ die Rede. Doch ein Gesetz, das eine solche verpflichtende Leistung pauschal für alle Krankenkassen vorsehen würde, existiert nicht.

Auch der Straßenverkehr bewegt viele Menschen – die Tiktok-Videos greifen das auf: Im März verbreiten sie, dass Autos künftig nur noch vom Fahrzeughalter gefahren werden dürfen – sonst drohten drastische Strafen. So eine gesetzliche Änderung gab es aber nicht, wie ein dpa-Faktencheck zeigt. Ebenso erfunden ist ein verpflichtender Führerschein für E-Scooter. In anderen Fällen werden längst eingeführte Maßnahmen wie das Wohngeld als neu verkauft. Seit dem Sommer 2024 hat die dpa rund 30 Faktenchecks zu Falschmeldungen veröffentlicht, die auch auf den hier untersuchten AI-Slop-Accounts auf Tiktok zu finden sind.

Manchmal verknüpfen die Kanäle die Alltagsthemen in ihren Videos mit kontroverser Krisenpolitik: Im Frühsommer 2025 verbreiten sich Videos mit erfundenen Behauptungen über einen vermeintlich neuen Solidaritätszuschlag zugunsten ausländischer Staaten wie der Ukraine oder Israel. Das erinnert an ein bekanntes Muster russischer Desinformation: Zweifel und Kritik an der Unterstützung der Ukraine durch Falschinformationen zu säen oder zu verstärken. Auf einigen der untersuchten Tiktok-Accounts thematisieren Videos auch immer wieder echte oder vermeintliche Entwicklungen im Ukraine-Krieg oder Äußerungen von Russlands Präsident Wladimir Putin. So mischen sich Aufreger über Alltagsthemen wie Geld und Verkehr mit typischen Desinformationsinhalten.

Das Narrativ: Der Willkür des Staates ausgeliefert

Der Staat erscheint in den Videos als eine Art Übermacht, neue Regelungen scheint er in dieser Welt nach Belieben einführen zu können. Wie das politische System Deutschlands tatsächlich funktioniert, spielt keine Rolle. Egal, wer die vermeintliche politische Änderung tatsächlich durchführen müsste – der Bundestag, die Bundesregierung, Länder oder Kommunen -, in den Videos gibt es für das drohende Ungemach oft nur einen Schuldigen: den Bundeskanzler.

So ist der KI-generierte Merz mit gerunzelter Stirn oft selbst dann im Hintergrund zu sehen, wenn es gar nicht um ihn geht oder er zuständig wäre; und auch der Text der KI-Stimme unterstellt Merz direkte Befugnis: „Friedrich Merz hat es verkündet“ sagt sie beispielsweise, obwohl Merz sich nie geäußert hat. Das Prinzip der Gewaltenteilung spielt keine Rolle.

Das wird zum Problem, wenn sich immer mehr Menschen auf Plattformen wie Tiktok über Politik informieren. Dieser Trend ist seit Jahren sichtbar, gerade unter den Jüngeren. Kritik am Staat und politischen Vorgaben sind selbstverständliche Bestandteile der Meinungsbildung in einer Demokratie – aber sie muss auf Grundlage von Fakten geäußert werden. Die Videos dagegen präsentieren einen Staat, der willkürlich in jeden Lebensbereich einzugreifen scheint und die Freiheiten seiner Bürger drastisch einschränkt. Wer die Kanäle konsumiert und ihnen Glauben schenkt, wird sich dem Staat hilflos ausgeliefert fühlen. Nachvollziehbar, wenn sich dann Ablehnung und sogar Hass gegenüber der Politik und ihren Repräsentanten entwickeln.

„Wenn hier nicht klar Desinformationskampagnen dominieren, geht es meiner Ansicht nach darum, den Ansatz zu verfolgen: Flood the Zone“, sagt der Tiktok-Experte Marcus Bösch. „Flood the Zone“ meint das Vermüllen einer Online-Plattform mit einem bestimmten Weltbild. Das Hauptziel sei Verunsicherung. „Es geht nicht darum, dass die Nutzer wirklich glauben, ab einem bestimmten Datum passiere etwas, sondern darum, mit der Möglichkeit zu spielen, dass es ja sein könne“, sagt Bösch. Am Ende bleibe der Eindruck: Die Elite, die da oben, die spinnen ja wohl mit ihren Vorschriften.

Einfluss oder Geld als Ziel?

Welche Motivation steht hinter den Accounts? Geht es um politische Desinformation? Die Videos bespielen einerseits ein typisches Narrativ: Der Staat wird als willkürlich und unberechenbar dargestellt, Politik als grundsätzlich nicht verlässlich. Aber ob die Accounts überhaupt das Ziel verfolgen, politische Desinformation zu verbreiten, bleibt aber unklar.

Denn andererseits wollen manche Profile in ihrer Account-Bio den Content zum Spaß umdeuten: „Satire! dient zur Unterhaltung!“, steht dort etwa. Aber der Satire-Hinweis wirkt wie Selbstschutz vor einer Sanktion durch Tiktok. Laut den Community Richtlinien gelten für satirische Inhalte bei Verstößen mitunter Ausnahmen.

Manchen Accounts geht es auch offensichtlich um Geld. Die Videos lösen Emotionen wie Frust und Zustimmung aus. Emotionen versprechen Reichweite – Reichweite auf Social-Media-Plattformen lässt sich monetarisieren.

Möglicher Verdienst über Affiliate-Programme

Ein Beispiel: Mehrere Profile einer untersuchten Gruppe um einen Account, der als Finanzexperte auftritt, teilten in ihrer Bio einen Link zu derselben Webseite. Dort wurde unter anderem für ein kostenloses Geschäftskonto – „ohne SCHUFA-Abfrage“ – des Fintech-Unternehmens Vivid Money geworben. Es handelte sich dort um einen sogenannten Business-Affiliate-Link. Schließt jemand über einen solchen Link einen neuen Kontovertrag ab, schütten die Unternehmen bei solchen Affiliate-Partnerprogrammen in der Regel eine Provision an den Vertriebspartner aus.

Eine Sprecherin von Vivid Money, teilte mit, dass eine spezialisierte Tiktok-Agentur für die Fintech-Firma das Business-Affiliate-Programm steuert. „Die Agentur wählt und prüft ihre Partner anhand von definierten Qualitäts- und Compliance-Kriterien.“ Genauere Angaben zu diesen Kriterien und um welche Agentur es sich handelt, machte Vivid Money nicht.

Die Kooperation mit dem Finanz-Account sei erst kürzlich angelaufen und aufgrund der Anfrage vorsorglich ausgesetzt worden. Es werde eine interne Überprüfung durchgeführt. Zu konkreten Provisionshöhen oder individuellen Ausschüttungen innerhalb des Affiliate-Programms wollte die Sprecherin aus Wettbewerbsgründen keine Angaben machen.

Nach der Anfrage verschwanden zahlreiche Clips von den Accounts der Gruppe. Die Profile entfernten zudem die hinterlegte Verlinkung. Stattdessen steht in der Beschreibung nun der Hinweis „Keine Finanzberatung“.

Auf der später entfernten Webseite war zudem Werbung für die Kreditvermittlungswebseite „Kredit.de“ zu sehen. Das Unternehmen reagierte auf eine Anfrage zur Zusammenarbeit mit dem Tiktok-Account nicht.

Einnahmen womöglich auch über Tiktok-Ausschüttungen

Dieses Beispiel zeigt: Wenn mit den fingierten Gesetzen Aufmerksamkeit erregt wird, dann lässt sich damit unter Umständen auch Geld verdienen. Doch nicht nur im Rahmen der Affiliate-Programme lässt sich auf Tiktok Reichweite zu Geld machen. Tiktok schüttet unter gewissen Bedingungen Geld an erfolgreiche Kanalbetreiber aus, über das sogenannte Creator Rewards Program, ein Modell für Belohnungen. Dafür müssen die Konten mindestens 10.000 Follower haben und im letzten Monat mindestens 100.000 Videoaufrufe verzeichnet haben. Ihre Videos müssen den Bedingungen der Plattform zufolge mindestens eine Minute lang und „Originalinhalte“ sein – also keine kopierten oder nachgemachten Inhalte.

Von den 32 Accounts, die dpa untersucht hat, kamen 30 auf mehr als 10.000 Follower, vielfach müssten auch die 100.000 monatlichen Videoaufrufe erreicht worden sein. Wer die Kriterien erfüllt, kann pro 1.000 sogenannten qualifizierten Views eines Video in den USA nach Experteneinschätzungen etwa 40 Cent bis 1 Dollar erhalten, in Deutschland erwähnen einzelne Creator etwas geringere Summen. Die genauen Zahlen sind unbekannt und hängen von vielen internen Faktoren ab. Ob ein Account tatsächlich über das Creator-Reward-Programm Geld erhält, lässt sich nicht nachvollziehen, einen Anspruch gibt es nicht. Tiktok äußerte sich auf dpa-Anfrage dazu nicht.

Dass Tiktok dabei auch Geld an missbräuchliche Accounts ausschütten könnte, sieht der Tiktok-Forscher Marcus Bösch nicht als Widerspruch. Die Plattform verdiene ja auch an solchen Inhalten. „Da ist das monetäre privatwirtschaftlich-kapitalistische Interesse letztlich höher als offensichtlich der Wille, die eigenen Community-Guidelines oder auch geltende Gesetze nicht brechen zu wollen“, sagt Bösch.

Millionen User sehen die Falschmeldungen

Einige der Accounts erreichen mit ihren Videos ein Millionenpublikum, zumindest ausweislich der View-Angaben der App. Auf den reichweitenstarken Accounts, die die dpa analysiert hat, gab es Videos mit mehr als drei Millionen Views. Der Fake über die Regelung, Autos dürfe nur noch derjenige fahren, der als Halter im Fahrzeugschein stehe, hatte beispielsweise 3,1 Millionen Aufrufe.

Andere Videos erreichen nur Zehn- bis Hunderttausende Nutzer. Warum ein Video viral gegangen ist, lässt sich kaum nachvollziehen. Die Accounts verbreiten immer wieder dieselben oder sehr ähnliche Geschichten. Manchmal wiederholt ein Profil erfundene Behauptungen in späteren Videos: Ein Tiktok-Account etwa hat in drei unterschiedlichen Monaten (Juni, August, September) Videos mit falschen oder verkürzten Informationen über den vermeintlichen 700-Euro-Anspruch für das Untersuchungsheft bei den Krankenkassen gepostet. Die Reichweite unterscheidet sich.

Die Videos erreichen viele tausend User, oft tauchen sie auf anderen Plattformen wie Facebook auf. Screenshots: GADMO/dpa-Factchecking

Die sensationsheischenden Videos mit den Falschinformationen verbreiten sich auch auf anderen Plattformen. Links zu einzelnen Tiktok-Videos werden auch bei Facebook oder X geteilt. Zum Teil werden die Clips dort auch neu hochgeladen. So verbreiten sie sich unabhängig von den ursprünglichen Tiktok-Accounts weiter.

Tiktok-Masche fällt Faktencheckern international auf

Eine Umfrage unter den GADMO-Partnern Correctiv, APA und AFP zeigt: Das Problem ist anderen deutschsprachigen Faktencheck-Organisationen seit Monaten bekannt.

Einzelne Videos erreichten Hunderttausende Views und breiteten sich auch auf anderen Plattformen wie Facebook aus, beobachtet die Correctiv-Journalistin Gabriele Scherndl. „Sobald ich Tiktok öffne, sehe ich innerhalb weniger Minuten ein vergleichbares Video.“ Die AFP-Faktencheckerin Isabelle Wirth beschreibt, dass die Behauptungen angesichts der Menge der Videos kaum noch zu prüfen seien. „Es wirkt fast wie eine Art ‘Beschäftigungstherapie’ für Faktenchecker*innen“, schreibt Wirth.

Niemand weiß, wie viele Tiktok-Accounts mit AI-Slop-Videos über falsche Behördenvorschriften existieren. Einen Einblick in das Ausmaß gibt eine weitere Recherche, die ähnlich wie die dpa vorging: Die „Faktenfuchs“-Redaktion des Bayerischen Rundfunks analysierte jüngst 19 Tiktok-Accounts mit Videos über erfundene politische Vorgaben. 13 Accounts löschte Tiktok nach einer Anfrage des BR. Die 32 von der dpa analysierten Accounts waren nicht darunter – sie waren nach der BR-Veröffentlichung noch immer online.

Auch in anderen Ländern fallen ähnliche Inhalte auf. Die britische Faktencheck-Plattform „Fullfact“ veröffentlichte Ende September eine Analyse von 14 Tiktok-Konten. Alle verbreiteten Videos über angebliche Maßnahmen der britischen Regierung oder Behörden. Nach einer Anfrage von „FullFact“ löschte Tiktok alle 14 Konten. Die US-amerikanische Plattform „Indicator“, die sich mit Desinformation und Online-Betrug beschäftigt, fand ähnliche spanischsprachige Videos über Fake-Vorschriften.

Tiktok kennt die Fake-News-Masche seit Monaten

Das Faktencheck-Team der dpa prüft im Auftrag von Tiktok Videos auf Falschinformationen. Im Rahmen dieser Kooperation hat das Faktencheck-Team der dpa seine Ansprechpartner bei Tiktok seit April 2025 mehrfach auf die beschriebene Masche hingewiesen. Denn die Videos verletzen die Regeln, die sich Tiktok selbst gegeben hat.

Tiktok verpflichtet die Nutzerinnen und Nutzer, auf KI-generierte Videos hinzuweisen: „Wir verlangen eine klare Kennzeichnung, wenn Inhalte mit KI erstellt oder bearbeitet wurden, um Personen oder Szenen realistisch darzustellen.“ Verboten ist KI-generierter Content, „der bezüglich Angelegenheiten von öffentlicher Bedeutung in die Irre führt oder Einzelpersonen schadet.“

Vereinzelt ist unter den Videos der untersuchten Accounts ein Hinweis auf die KI-Nutzung zu finden. Vielfach fehlt er aber. Und ob alle Nutzer durch den kleinen, hellgrauen Button „AI-generated“ ahnen, wie umfangreich KI für die Erstellung der Videos genutzt wurde, ist fraglich.

Auch Falschinformationen dürfen Tiktok-Videos eigentlich nicht verbreiten – um sie zu erkennen, gibt es etwa die Kooperation mit dem Faktencheck-Team der dpa. „Wir erlauben keine Fehlinformationen, die Einzelnen oder der Gesellschaft erheblichen Schaden zufügen könnten“, schreibt Tiktok in seinen Community-Richtlinien.

Tiktok verweist auf Schwierigkeiten, irreführende Inhalte zu erkennen

Vereinzelt sind Videos oder Accounts nach den Hinweisen des dpa-Faktencheck-Teams gelöscht worden – aus welchen Gründen und ob das mit den Hinweisen in Verbindung steht, ist der dpa nicht bekannt. Im Laufe der Recherche verschwanden weitere Accounts oder Videos, ohne dass es kurz zuvor Hinweise des dpa-Teams gab.

Auf Anfrage verwies eine Sprecherin auf die erwähnten Community-Regeln: „Tiktok setzt auf einen verantwortungsvollen Umgang mit KI-Inhalten: Realistische KI-Medien müssen klar gekennzeichnet sein, schädliche oder irreführende Inhalte sind verboten.“ Die Plattform entferne 97 Prozent der regelwidrigen Inhalte proaktiv. Zudem entwickle man die Richtlinien kontinuierlich weiter, um mit der Technologie Schritt zu halten.

Es sei schwierig, solche Inhalte in großem Umfang zuverlässig zu erkennen. Die Plattform arbeite mit anderen Unternehmen und Expertinnen und Experten zusammen, um die Herausforderung zu bewältigen. Zugleich entwickle man die eigenen Systeme ständig weiter – mit automatischen Erkennungsregeln basierend auf zuvor identifizierten KI-Inhalten und anderen Methoden, wie einer Analyse von Schlüsselbegriffen.

Neue Videos nach bekanntem Muster weiterhin auffindbar

Zu der Masche mit den erfundenen staatlichen Vorschriften äußerte sich die Plattform nicht. Sie verwies auf strenge Richtlinien für bestimmte Arten von Fehlinformationen und auf Maßnahmen, die Tiktok zum Schutz vor Desinformation ergreift. „Wir erkennen Fehlinformationen mittels automatisierter Technologie, Meldungen von Nutzer*innen sowie proaktiver Berichte von Expert*innen und unseren Faktencheck-Partnern“, heißt es dort.

Weniger als 24 Stunden nachdem dpa Tiktok um eine Einschätzung zu den 32 untersuchten Accounts dieser Recherche gebeten hat, sind alle gelöscht worden. Die Plattform habe die geteilten Accounts und weitere geprüft, teilt das Unternehmen mit, und jene, „die gegen unsere Community Richtlinien verstoßen“, entfernt.

Aus Sicht des Tiktok-Experten Marcus Bösch verfahre die Plattform Tiktok nach der Devise, Inhalte online zu lassen und sie nur nach Hinweisen zu prüfen und zu löschen. „Die Regeln, die Community-Guidelines, sind ja relativ eindeutig und der Druck durch die europäischen Regelungen, egal ob das jetzt AI Act oder der Digital Services Act ist, werden auch strenger. An Tiktok gerichtet bliebe nur der Appell, die eigenen Regeln anzuwenden – was aber seit Jahren flächendeckend ganz offensichtlich nicht passiert“, sagt Bösch.

Doch das Schema „Achtung, ab dem …“ hat es dabei offensichtlich noch nicht in die Liste der analysierten Schlüsselbegriffe und automatisierten Erkennungsregeln von Tiktok geschafft: Ende Oktober verbreiten zahlreiche Accounts die nächste virale Falschmeldung. Ab Dezember soll nächtliches Autofahren verboten sein.